400-800-9260

工作日8:00-19:00 在线服务

400-800-9260

爱短链平台各工具使用方法及功能汇总

短链接

活码系统

微信外链

抖音卡片

相关搜索

收集用户信息后自动邀请入群?原来表单与社群联动还能这样玩

表单提交后还要手动拉群?这招让你收集用户信息的同时自动邀请入群,表单与社群无缝联动。填完表单直接进群,省去逐个添加的麻烦,活动运营、课程招生都能用上,从此告别手动拉人的重复劳动。

爱短链

2026-02-03 15:48:19

扫码自动识别新老客户?活码按标签分流进群,这招绝了

还在手动拉人进群?用活码就能让客户扫码后自动识别身份,新客进a群老客进b群。设置好标签规则,系统自动判断合作时长和购买记录,一个码搞定所有分流场景,再也不用担心拉错群了。

爱短链

2026-01-22 18:49:49

微信加人频繁怎么办?爱短链活码系统解决难题!

面对微信频繁添加好友的限制,巧妙运用爱短链活码系统不仅能解决问题,还能让引流效率翻倍。

爱短链

2025-11-20 14:47:44

创建短链接

注册与登录 首先,访问爱短链的官方网站,点击右上角的“注册”按钮,填写相关信息完成注册。注册成功后,使用账号和密码登录到平台后台。登录过程简单快捷,支持微信扫码和手机验证码等多种方式。 获取长链接 在准备创建短链接之前,你需要先获取想要缩短的长链接。例如,在微信公众号后台,打开需要生成短链接的文章,将该文章的长链接复制到剪贴板中。 生成短链接 登录爱短链平台后,你会看到后台界面提供了多种功能选项。点击“短链”功能,将刚刚复制的长链接粘贴到指定的输入框中。爱短链还允许用户绑定自己的域名,使短链接更具个性化和辨识度。设置完成后,点击“生成短链接”按钮,平台会立即为你生成对应的短链接。 使用短链接 短链接生成后,你可以将其复制并粘贴到公众号推文中需要添加链接的位置,如正文内容、阅读原文链接、公众号菜单栏等。在正文中插入短链接时,可以搭配一些吸引人的引导语,如“点击下方链接查看更多精彩内容”或“详情请戳[短链接]”等,以提高用户的点击率。

爱短链

2025-02-21 09:40:14

抖音链接跳转微信

抖音链接跳转微信不仅为品牌营销和个人推广提供了更多可能性,也为用户带来了更加便捷、高效的信息获取和互动体验。在未来,随着社交电商的蓬勃发展和用户需求的不断变化,抖音链接跳转微信将成为越来越多用户的首选引流方式,助力品牌营销和个人推广迈向新的高度。

爱短链

2025-01-15 16:45:50

活码二维码生成器在线

活码二维码生成器在线工具如爱短链等,操作简单,无需复杂的技术知识。用户只需在网页上打开相应的生成器平台,按照提示进行操作即可。通常,用户需要输入想要关联的信息,如网址、文本、图片、文件等,然后选择一些个性化设置,即可快速生成一个活码二维码。

爱短链

2025-01-15 16:47:20

用户喜欢

缩短链接:链接在线一键秒缩短

缩短链接是一种将长网址转换为短网址的服务,通常用于社交媒体、短信、电子邮件等场合,以便更简洁地分享链接。以下是一些在线一键缩短链接的方法和工具:

爱短链

2025-02-19 10:23:43

网址简化:1秒简化网址

网址简化,也称为url缩短,是指将冗长的网址转换为简短、易记的链接。以下是几种快速简化网址的方法:

爱短链

2025-02-19 10:23:29

网站链接太长怎么缩短

当遇到网站链接太长需要缩短的情况时,可以采取以下几种方法:

爱短链

2025-03-19 11:52:51

h5页面跳转微信小程序

h5页面跳转微信小程序的需求普遍存在,因为微信小程序只能在微信内部访问,而h5页面可以在任何浏览器中访问,因此需要通过跳转来实现两者之间的衔接。以下是h5页面跳转微信小程序的主要方式:

爱短链

2025-02-18 16:09:11

链接缩短,教程分享,一招把链接缩短

链接缩短是一个方便用户分享和访问长链接的有效方法。以下是一招把链接缩短的详细教程:

爱短链

2025-02-18 16:09:27

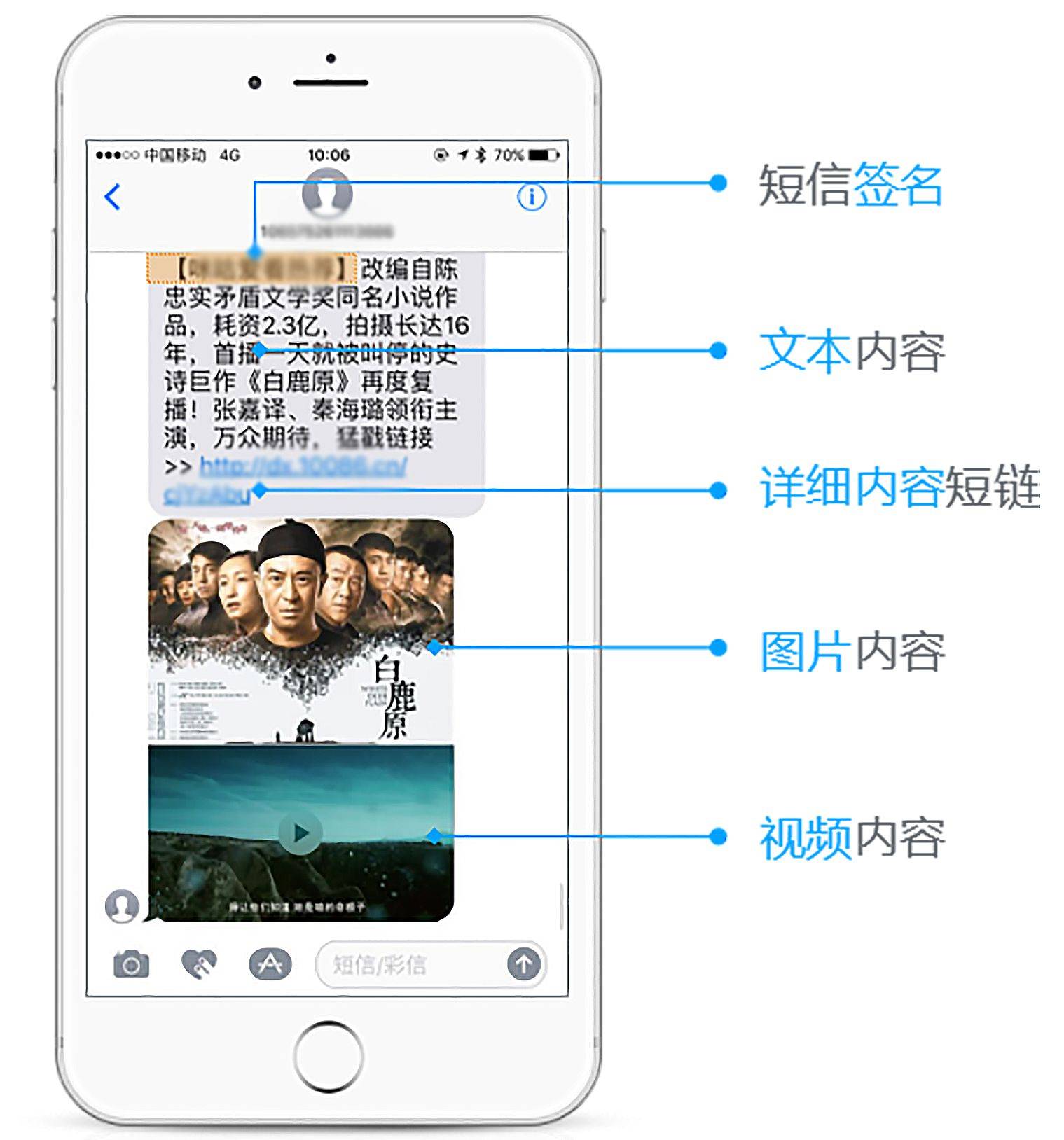

微信卡片链接生成

微信卡片链接是指在微信中分享的一个特定格式的链接,通过该链接可以展示网页或内容的相关信息,并以卡片的形式呈现给接收者。以下是生成微信卡片链接的详细步骤:

爱短链

2025-02-18 10:00:16

添加客服微信

咨询领取专属优惠